Đạo đức Trí tuệ nhân tạo: Thực trạng, thách thức và giải pháp về an toàn thông tin

Sự phát triển nhanh chóng của trí tuệ nhân tạo (AI) đặt ra nhiều thách thức lớn về đạo đức, đặc biệt trong lĩnh vực an toàn thông tin (ATTT), bảo mật và quản lý dữ liệu. Bài báo này khảo sát các vấn đề chính yếu của đạo đức AI tại một số quốc gia phát triển về AI như Mỹ, Trung Quốc, Liên minh châu Âu (EU), Nhật Bản, Australia... đồng thời phân tích các framework điển hình về đạo đức AI, đánh giá vai trò quản lý quốc gia trong xây dựng và thực thi tiêu chuẩn đạo đức và đi sâu vào mối quan hệ giữa đạo đức AI và ATTT. Từ đó, bài báo đưa ra một số khuyến nghị và nhận định cho lĩnh vực ATTT trong bối cảnh chuyển đổi số toàn cầu.

TỔNG QUAN VỀ ĐẠO ĐỨC AI

Sự bùng nổ của công nghệ AI đã và đang làm thay đổi căn bản mọi mặt của đời sống xã hội, mang lại tiềm năng to lớn nhưng đồng thời mở ra loạt vấn đề mới về đạo đức, trách nhiệm, minh bạch và ATTT [1, 2]. Trong lĩnh vực ATTT, AI vừa là công cụ hỗ trợ, vừa tiềm ẩn các nguy cơ an ninh phi truyền thống. Thực tế này đòi hỏi phải xây dựng các khuôn khổ đạo đức toàn diện cho AI – không chỉ ở tầm quốc gia mà còn ở cấp độ toàn cầu, đa ngành và đa văn hóa.

Khái niệm và nhu cầu về chuẩn đạo đức AI

Khác với nhiều công nghệ truyền thống, AI có khả năng học hỏi, suy đoán và tự động ra quyết định ở mức độ ngày càng cao. Điều này đặt ra nhu cầu kiểm soát các rủi ro đạo đức liên quan đến quyền riêng tư, công bằng, minh bạch, quyền tự chủ của con người và những tác động xã hội sâu rộng [1, 2, 3]. Các chuẩn mực đạo đức AI không chỉ dừng ở các nguyên lý trừu tượng (nguyên tắc “không gây hại”, “minh bạch”, “tôn trọng quyền tự chủ”...), mà phải hướng đến cơ chế vận hành thực tế, cụ thể với từng ngành, từng quốc gia [4].

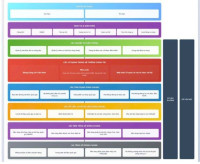

Các bộ khung tiêu chuẩn Đạo đức AI lớn trên thế giới

Hiện nay, nhiều bộ khung/chuẩn đạo đức AI điển hình được công nhận và áp dụng rộng rãi như:

- Khuyến nghị của UNESCO (2021): Nhấn mạnh quyền con người, bền vững, đa dạng văn hóa, công lý, trách nhiệm giải trình và bảo vệ môi trường [1].

- Hướng dẫn đạo đức AI của WHO (2021): Tập trung vào các nguyên tắc: bảo vệ quyền tự chủ, thúc đẩy phúc lợi - an toàn, minh bạch - giải thích, trách nhiệm, toàn diện, bền vững và có phản ứng thích ứng [2].

- IEEE Ethically Aligned Design: Đề xuất loạt tiêu chuẩn kỹ thuật và nguyên tắc cốt lõi như quyền con người, minh bạch thuật toán, quản lý dữ liệu, công bằng, phòng tránh lạm dụng công nghệ AI [3].

Ngoài ra còn các bộ khung khu vực như Hướng dẫn đạo đức AI của EU (AI HLEG), chiến lược AI quốc gia của Mỹ, Trung Quốc, Nhật Bản, Australia... sẽ được phân tích chi tiết sau đây.

KHẢO SÁT VÀ PHÂN TÍCH CÁC BỘ KHUNG VỀ ĐẠO ĐỨC AI TẠI MỘT SỐ QUỐC GIA

EU: Tiêu chuẩn đạo đức AI đặt quyền con người và minh bạch lên hàng đầu

EU là khu vực tiên phong trong xây dựng các quy định toàn diện về AI cả ở tầm nguyên tắc (AI HLEG, AI Act) lẫn nghĩa vụ thực thi. Bộ khung đạo đức AI của EU nhấn mạnh: Tôn trọng quyền con người, công bằng, không phân biệt đối xử; Tính minh bạch, giải thích được quyết định của AI, đảm bảo trách nhiệm giải trình; An ninh, an toàn hệ thống, bảo vệ dữ liệu cá nhân; Cơ chế kiểm định, giám sát độc lập; đánh giá tác động đạo đức và xã hội trước khi triển khai; Quan tâm đặc biệt tới AI trong lĩnh vực nhạy cảm: y tế, tài chính, an ninh...

Bộ đạo đức AI của EU hướng đến “AI tin cậy” (trustworthy AI), đồng thời yêu cầu các hệ thống AI “có độ rủi ro cao” (high risk) phải tuân thủ đánh giá tác động đạo đức và quản trị rủi ro xuyên suốt vòng đời sản phẩm [1, 4].

Mỹ: Đa dạng hóa chính sách và nhấn mạnh công bằng, đổi mới, tự do cá nhân

Chính sách đạo đức AI tại Mỹ mang tính phân tán, chú trọng sự tự điều chỉnh của ngành, đồng thời đề cao đổi mới sáng tạo. Bộ khung nổi bật như của Viện Tiêu chuẩn quốc gia (National Institute of Standards and Technology) “NIST AI Risk Management Framework (AI RMF)” tập trung vào: Giảm thiểu rủi ro, tăng tính minh bạch, thúc đẩy trách nhiệm giải trình; Không đưa ra các ràng buộc cứng mà ưu tiên hướng dẫn tự nguyện, đảm bảo sự linh hoạt theo bối cảnh sử dụng; Chú trọng quyền cá nhân, tôn trọng luật pháp hiện hành (ví dụ về đạo đức AI trong luật pháp - lĩnh vực pháp lý của Mỹ) [8].

Ở lĩnh vực pháp lý, câu hỏi lớn vẫn là: Quyết định của AI có thể là “thẩm phán” không? Trách nhiệm đạo đức của luật sư khi sử dụng AI, đặc biệt là AI tạo sinh (Generative AI) đang được tranh luận mạnh mẽ tại Mỹ [8].

Một trường hợp điển hình cụ thể là JP Morgan, IBM Watson Health (EU, Mỹ) và ứng dụng thực tế đã xảy ra: IBM Watson Health ở EU phải đáp ứng yêu cầu minh bạch giải thích và trách nhiệm giải trình khi ứng dụng AI chẩn đoán y khoa. Còn JP Morgan tại Mỹ áp dụng quy trình “kiểm toán” nội bộ để kiểm soát rủi ro AI trong phát hiện gian lận tài chính - mô hình Mỹ đặt nặng sự linh hoạt, giám sát nội bộ hơn kiểm soát tập trung [5]. Như vậy có thể thấy là việc tăng cường cơ chế kiểm tra, đánh giá đạo đức AI định kỳ là xu hướng không thể đảo ngược.

Trung Quốc: Đổi mới tích hợp nhà nước và an toàn xã hội

Trung Quốc phát triển các nguyên tắc đạo đức AI trên nền tảng “an ninh quốc gia, hài hòa xã hội” [6], cụ thể: Nhấn mạnh kiểm soát tập trung của nhà nước ở toàn bộ vòng đời phát triển, triển khai AI; Yêu cầu nghiêm ngặt về sử dụng dữ liệu (luật bảo vệ dữ liệu cá nhân, quyền sở hữu dữ liệu); Thiết lập hướng dẫn AI Ethics Guideline cho doanh nghiệp, nhấn mạnh hài hòa xã hội, phát triển bền vững; Quy định minh bạch thuật toán, cấm sử dụng AI để lật đổ an ninh quốc gia, gây rối xã hội; Yêu cầu giải thích và kiểm soát mục tiêu AI theo các tiêu chí do Nhà nước định hướng.

Nhật Bản: Nhấn mạnh cộng đồng, trách nhiệm xã hội và đồng sáng tạo

Nhật Bản xây dựng khung “AI hướng con người”, lấy cộng đồng làm gốc [1], nhấn mạnh: Phát triển AI hài hòa với bản sắc văn hóa, tôn trọng đa dạng xã hội; Bảo đảm an toàn, bảo vệ quyền riêng tư dữ liệu; Chính sách hợp tác đa bên với doanh nghiệp, viện nghiên cứu và xã hội dân sự; Minh bạch hóa, tăng khả năng giải thích, xây dựng niềm tin cộng đồng; Thúc đẩy đạo đức trong hệ sinh thái AI đồng kiến tạo.

Australia: Đạo đức AI trên nền tảng tự do cá nhân, công bằng và tin cậy

Australia công bố “Bộ nguyên tắc đạo đức AI” [7], gồm tám mục tiêu chính: 1. Quyền con người, quyền riêng tư, bảo vệ dữ liệu; 2. Công bằng, không thiên vị; 3. Tính bảo mật và đáng tin cậy; 4. Minh bạch và giải thích được; 5. Trách nhiệm và giám sát; 6. Bảo vệ tự chủ cá nhân, nâng cao năng lực cộng đồng; 7. Mức độ phù hợp theo bối cảnh; 8. Đánh giá, quản trị rủi ro xuyên suốt vòng đời AI.

ĐẠO ĐỨC AI TRONG QUẢN LÝ VÀ ĐIỀU HÀNH QUỐC GIA

Khung pháp lý và quản trị đóng vai trò trung tâm nhằm hiện thực hóa các giá trị đạo đức vào thực tế [1, 3, 4]. Những yếu tố đáng chú ý gồm:

- Luật hóa các nghĩa vụ đạo đức: Chẳng hạn như GDPR của EU, Đạo luật Bảo vệ thông tin cá nhân tại Trung Quốc, quy định trách nhiệm pháp lý cho AI tại Mỹ,...

- Thiết lập ủy ban đạo đức, tổ chức đánh giá tác động AI toàn diện: Nhiều nước và tổ chức quốc tế thành lập hội đồng/ủy ban độc lập giám sát đạo đức AI.

- Áp dụng các phương pháp đánh giá tác động đạo đức - văn hóa - xã hội AI: Chẳng hạn, mô hình eTA (ethical Technology Assessment) ở EU, mô hình kiểm toán đạo đức ở WHO, UNESCO...

- Yêu cầu minh bạch, kiểm chứng thuật toán: Bố trí cơ chế kiểm toán độc lập, công bố thông tin các thuật toán ảnh hưởng lớn tới quyền lợi công dân, định hướng trách nhiệm giải trình thuật toán [3, 4].

- Ràng buộc trách nhiệm pháp lý cá nhân và tổ chức: Quy định chủ thể có trách nhiệm cuối cùng với mọi hành vi, quyết định của hệ thống AI.

ĐẠO ĐỨC AI VÀ VẤN ĐỀ ATTT, AN NINH MẠNG

AI làm thay đổi diện mạo an ninh mạng và ngày càng hiện diện trong cả tấn công lẫn phòng thủ an ninh mạng: AI tự động hóa phát hiện mối đe dọa, phân tích dấu hiệu tấn công zero-day, sàng lọc log dữ liệu số lượng lớn. Ngược lại, AI bị lợi dụng để chế tạo mã độc biến hình thông minh, deepfake, tự động tìm lỗ hổng bảo mật mới [5].

Một số vấn đề then chốt liên quan đến các thách thức và yêu cầu đạo đức AI trong ATTT gồm có:

- Minh bạch: AI xử lý và ra quyết định phải có khả năng giải thích, kiểm chứng để hạn chế các rủi ro tạo ra các quyết định không kiểm soát, thiên vị hoặc gây tổn hại người dùng [3, 5].

- Công bằng và không phân biệt đối xử: AI dùng trong xác thực, phát hiện gian lận hoặc kiểm tra truy cập không được phép gây ra sự thiên vị dựa trên các đặc tính nhạy cảm (giới, chủng tộc...).

- Quyền riêng tư và bảo vệ dữ liệu: AI cần tuân thủ nghiêm ngặt quy định về bảo mật, xử lý dữ liệu; bảo vệ thông tin cá nhân khỏi bị xâm phạm hoặc lạm dụng trong các hệ thống an ninh và giám sát mạng [1, 2].

- Trách nhiệm giải trình: Xác định rõ khâu chịu trách nhiệm khi AI gây ra thiệt hại trong các hệ thống bảo mật (ví dụ AI phát hiện nhầm hành vi hợp pháp là hành vi nguy hiểm).

- Giám sát và đánh giá: Đề xuất triển khai các hệ thống đánh giá, kiểm toán AI định kỳ, đặc biệt ở các môi trường yêu cầu độ tin cậy thông tin tuyệt đối như tài chính, y tế, cơ quan nhà nước.

KẾT LUẬN

Bài học quan trọng từ một số quốc gia phát triển về AI là: Đạo đức AI không chỉ là bộ nguyên tắc lý thuyết mà phải hiện thực hóa thành công cụ pháp lý, chính sách quản lý cụ thể và cơ chế kiểm toán, giám sát phù hợp với từng môi trường ứng dụng [1- 8]. Đối với lĩnh vực ATTT, cần đặc biệt chú trọng các yếu tố như giải thích quyết định AI, kiểm soát rủi ro thu thập/sử dụng dữ liệu nhạy cảm, kiểm toán và đánh giá định kỳ tương tác AI - an toàn hệ thống. Bản thân chuyên gia ATTT cũng phải được trang bị kiến thức đạo đức AI hiện đại để chủ động định hình, kiểm soát và điều phối các giải pháp bảo mật sử dụng AI trong thực tiễn. Việt Nam cần chủ động tham khảo kinh nghiệm quốc tế, xây dựng hệ sinh thái khung chuẩn đạo đức AI phù hợp, đồng thời lồng ghép sâu sắc các yếu tố đạo đức - ATTT khi hoạch định chiến lược chuyển đổi số và đảm bảo an ninh mạng quốc gia trong bối cảnh mới.

Tác giả: TS. Ngô Hải Anh (Viện Công nghệ thông tin - Viện Hàn lâm Khoa học và Công nghệ Việt Nam)

Nguồn tin: Tạp chí An toàn thông tin

Tin đọc nhiều nhất

-

Luật số 91/2025/QH15: Luật Bảo vệ dữ liệu cá nhân 2025

Luật số 91/2025/QH15: Luật Bảo vệ dữ liệu cá nhân 2025

-

5 cách giúp hạn chế việc rò rỉ thông tin cá nhân khi sử dụng Internet

5 cách giúp hạn chế việc rò rỉ thông tin cá nhân khi sử dụng Internet

-

Một số cách nhận diện website giả mạo để tránh bẫy lừa đảo trực tuyến

Một số cách nhận diện website giả mạo để tránh bẫy lừa đảo trực tuyến

-

Hướng dẫn triển khai Kế hoạch số 02 về thúc đẩy chuyển đổi số đáp ứng yêu cầu sắp xếp, tổ chức lại bộ máy

Hướng dẫn triển khai Kế hoạch số 02 về thúc đẩy chuyển đổi số đáp ứng yêu cầu sắp xếp, tổ chức lại bộ máy

-

Ứng dụng trí tuệ nhân tạo hỗ trợ cải cách thủ tục hành chính trong giai đoạn chuyển đổi số hiện nay

Ứng dụng trí tuệ nhân tạo hỗ trợ cải cách thủ tục hành chính trong giai đoạn chuyển đổi số hiện nay

-

WormGPT 4 và KawaiiGPT: Dark LLM mới thúc đẩy tự động hóa tội phạm mạng

WormGPT 4 và KawaiiGPT: Dark LLM mới thúc đẩy tự động hóa tội phạm mạng

-

Nhiệm vụ và giải pháp trọng tâm của Nghệ An trong triển khai thực hiện Nghị quyết 57-NQ/TW của Bộ Chính trị

Nhiệm vụ và giải pháp trọng tâm của Nghệ An trong triển khai thực hiện Nghị quyết 57-NQ/TW của Bộ Chính trị